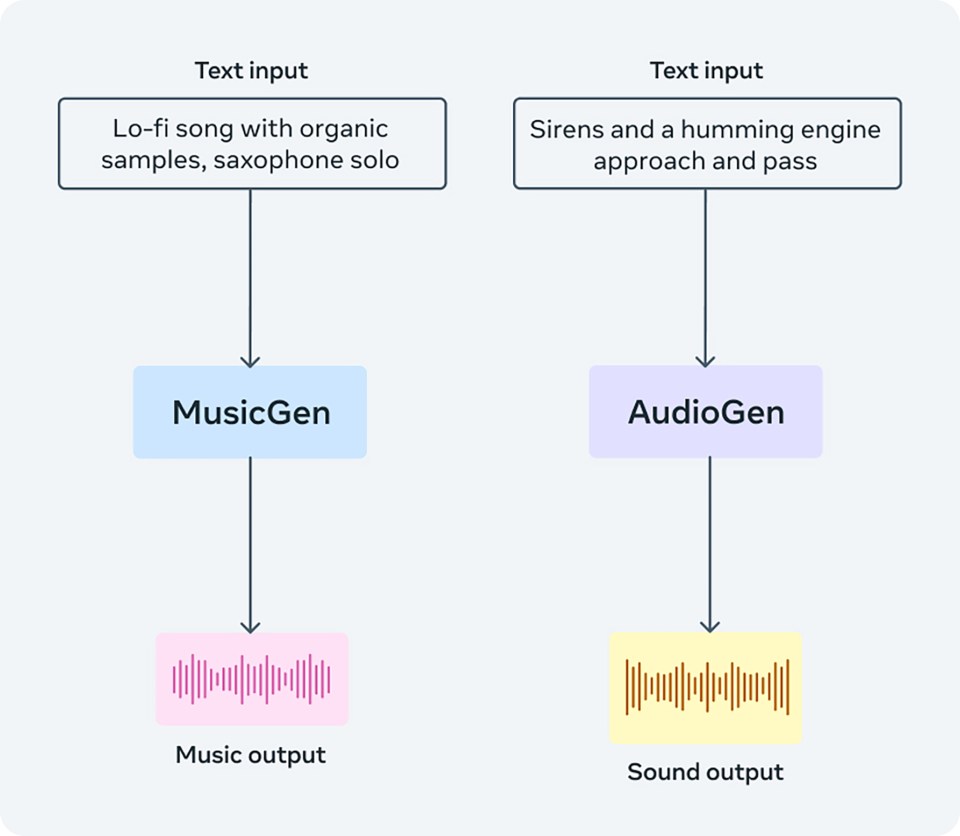

AudioCraft 包含了三个核心组件:

MusicGen:使用 Meta 拥有 / 特别授权的音乐进行训练,根据文本提示生成音乐。

AudioGen:使用公共音效进行训练生成音频或扩展现有音频,后续还可生成环境音效(如狗叫、汽车鸣笛、木地板上的脚步声)。

相关研究人员和从业人员可以使用自己的数据集训练模型。官方宣称 AudioCraft 系列模型能够长期稳定地生成高质量音频,而且易于使用,能够为音乐家和声音设计师“提供灵感”,帮助他们快速集思广益,并“以新的方式迭代他们的作品”。

今年 6 月份 Meta 开源了 AI 语言模型 MusicGen,该模型基于谷歌 2017 年推出的 Transformer 模型。如同模型名称所示,MusicGen 主要用于音乐生成,它可以将文本和已有的旋律转化为完整乐曲。

演示视频:

AudioCraft 项目地址:点此前往